La música generada por la inteligencia artificial ya es un archivo Concepto suficientemente innovadorpero Riffusion lo lleva a otro nivel con un enfoque ingenioso y peculiar que produce música peculiar y pegadiza usando no sonido pero Fotos del sonido

Parece extraño, extraño. Pero si funciona, funciona. ¡Y funciona! algo así como.

Diffusion es un enfoque de aprendizaje automático para la generación de imágenes que ha sobrealimentado el mundo de la IA durante el último año. DALL-E 2 y Stable Diffusion son los dos modelos más famosos que funcionan reemplazando gradualmente el ruido visual con lo que la IA cree que debería sonar.

Se ha demostrado que este método es efectivo en muchos contextos y es muy susceptible de ajustes finos, lo que a menudo le da al modelo entrenado una gran cantidad de un tipo particular de contenido para que se especialice en la producción de más ejemplos de ese contenido. Por ejemplo, puede configurarlo para acuarelas o retratos de automóviles, y será más capaz de reproducir cualquiera de esas cosas.

Lo que hicieron Seth Forsgren y Hayk Martiros para su proyecto de pasatiempo, Riffusion, fue establecer la difusión estable en espectrogramas.

«Heike y yo tocamos juntos en una pequeña banda, y comenzamos el proyecto simplemente porque amamos la música y no sabíamos si Stable Diffusion podía generar una imagen de espectrograma con suficiente precisión para convertirla en audio». Forsgren le dijo a TechCrunch. “En cada paso del camino, nos impresionó cada vez más lo que era posible, una idea que conducía a la siguiente”.

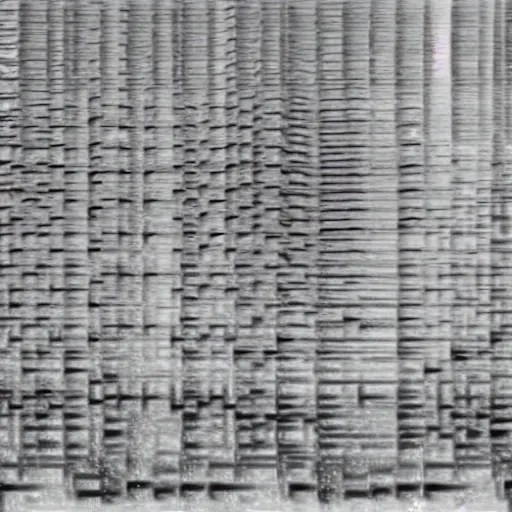

¿Qué son los gráficos de espectro, preguntas? Son representaciones visuales de sonido que muestran las amplitudes de diferentes frecuencias a lo largo del tiempo. Es posible que haya visto formas de onda que muestran volumen a lo largo del tiempo y hacen que el sonido suene como una serie de colinas y valles; Imagina que en lugar de solo el volumen general, muestra el volumen de cada frecuencia, desde el extremo inferior hasta el extremo superior.

Esto es parte de una canción que hice («Radio Marconi» para Máquinas Secretassi te lo preguntabas):

Créditos de la imagen: Devin Koldoy

Puede ver cómo se vuelve más fuerte en todas las frecuencias a medida que se desarrolla la canción, e incluso puede seleccionar notas e instrumentos individuales si sabe qué buscar. El proceso no es inherentemente perfecto o sin pérdidas de ningún modo, pero es una representación precisa y sistemática del sonido. Y puede volver a convertirlo en sonido haciendo el mismo proceso a la inversa.

Forsgren y Martiros hicieron espectrógrafos de una variedad de música y etiquetaron las imágenes resultantes con los términos relevantes, como «guitarra blues», «piano jazz», «afrobeat», cosas así. Alimentar al modelo le dio a este grupo una buena idea de cómo se ven ciertos sonidos y cómo se pueden recrear o combinar.

Así es como se ve el proceso de difusión si lo prueba mientras optimiza la imagen:

Créditos de la imagen: Seth Forsgren / Heike Martiros

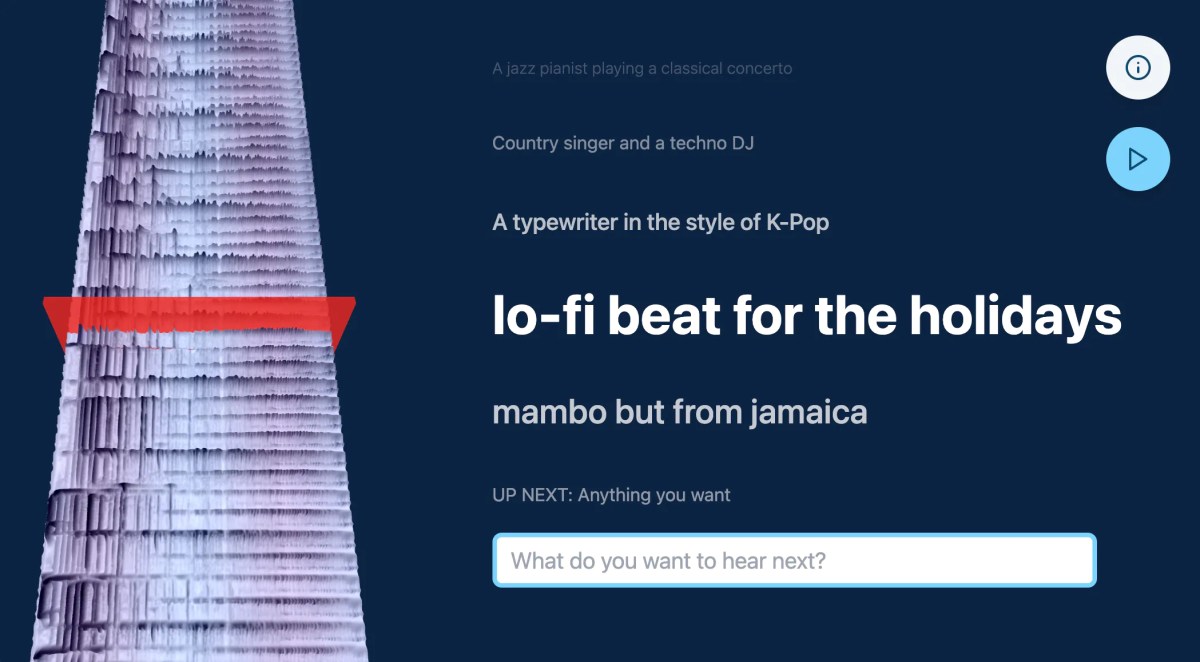

De hecho, el modelo ha demostrado su capacidad para producir espectrogramas que, cuando se convierten en sonido, son una buena combinación para estímulos como «piano funky», «saxofón jazz», etc. Esto es un ejemplo:

Créditos de la imagen: Seth Forsgren / Heike Martiros

Pero, por supuesto, el espectrograma cuadrado (512 x 512 píxeles, resolución de dispersión fija estándar) es solo un breve fragmento; Una canción de tres minutos será un rectángulo mucho más ancho. Nadie quiere escuchar música cinco segundos a la vez, pero las limitaciones del sistema que construyeron significa que no pueden simplemente crear un espectrograma de 512 píxeles de largo y 10,000 de ancho.

Después de probar algunas cosas, aprovecharon la infraestructura de modelos grandes como Stable Diffusion, que tienen una gran cantidad de «espacio latente». Esto es un poco como la tierra de nadie entre nodos más específicos. Por ejemplo, si tiene un área del modelo que representa a los gatos y otra que representa a los perros, lo que está «en el medio» es un espacio latente que, si solo le dice a la IA que dibuje, será una especie de perro, o un gato, aunque no existe tal cosa.

Coincidencia, Las cosas del espacio al acecho se vuelven aún más raras que eso:

Sin embargo, no hay mundos de pesadilla aterradores para el proyecto Riffusion. En cambio, descubrieron que si tiene dos enrutadores, como «campanas de iglesia» y «tonos electrónicos», puede pasar de uno a otro poco a poco y desvanecerse gradualmente y sorprendentemente de forma natural de uno a otro. el otro, en un compás parejo:

Suena extraño e interesante, aunque claramente no es complejo ni de alta fidelidad; Recuerde, ni siquiera estaban seguros de que los modelos extendidos pudieran hacer eso, por lo que la facilidad con la que este dispositivo convierte las campanas en repiques o los clics de máquina de escribir en pianos y bajos es bastante notable.

Es posible producir segmentos de una forma más larga, pero aún es teórico:

«Realmente no estábamos tratando de crear una canción clásica de 3 minutos con coros y versos cantados», dijo Forsgren. «Creo que esto se puede hacer con algunos trucos inteligentes, como construir un modelo de nivel superior de la estructura de la canción y luego usar el modelo de nivel inferior para las sílabas individuales. Alternativamente, podrías entrenar nuestro modelo en profundidad usando imágenes de resolución mucho más alta del canciones completas.”

¿Adónde van desde aquí? Otros grupos están tratando de crear música generada por IA de diferentes maneras, comenzando con el uso de modelos de síntesis de voz a sonidos especialmente entrenados como Propagación de baile.

Riffusion es más un «wow, mira esa demostración» que cualquier tipo de gran plan para reinventar la música, y Forsgren dijo que él y Martiros estaban felices de ver a las personas involucrarse con su trabajo, disfrutarlo y repetirlo:

«Hay tantas direcciones que podemos tomar a partir de aquí, y estamos emocionados de seguir aprendiendo en el camino. Ha sido divertido ver a otras personas realmente construir sus propias ideas sobre el código también esta mañana. Una de las cosas increíbles sobre la comunidad de Stable Diffusion es lo rápido que la gente lo hace». Construir sobre cosas en direcciones que los autores originales no podían predecir».

Puede probarlo en una demostración en vivo en riffusion.com, pero es posible que tengas que esperar un poco para que tu clip se publique; esto recibió un poco más de atención de lo que esperaban los creadores. El código está completamente disponible. a través de la página acerca deasí que siéntete libre de jugar el tuyo también, si tienes las fichas adecuadas para ello.

«Adicto a la música. Gurú del café. Especialista en zombis. Defensor de las redes sociales. Introvertido. Aficionado extremo a la comida. Evangelista del alcohol».